No. Repetir tu prompt no le da superpoderes a tu asistente

Por qué esta técnica, que se ha puesto de moda, probablemente no te sirva para nada

Ok, ok… tal vez el título de este post fue un poco extremo, pero es que veo a todo el mundo hablando de esta técnica como si fuera la última maravilla (y no lo es).

La técnica viene de un paper de Google Research llamado Prompt Repetition Improves Non-Reasoning LLMs y básicamente dice que cuando le das dos veces el mismo prompt a tu IA te responde mejor.

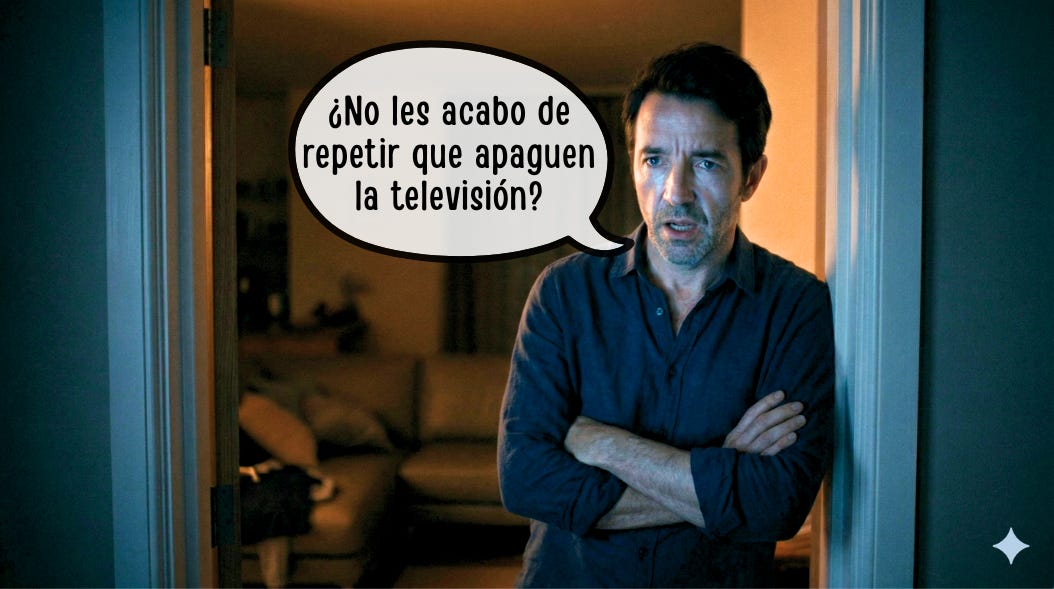

A mí me parece la versión para las máquinas de cuando mis papás me decían, con todo el amor del mundo:

¿Germán, cuántas veces tengo que repetirte lo mismo?!!!!!!!!!!

Antes de seguir, por favor dime que no soy el único a quien sus padres le han dicho esto. 😅

Y el paper trata de eso, parece que la IA responde mejor cuando le repites el prompt, aunque hay un pequeñísimo detalle que nadie está mencionando…

¿Germán, por qué esta técnica no me va a servir?

¡Buena pregunta!

¿Recuerdas que el paper se llama “Prompt Repetition Improves Non-Reasoning LLMs”? Pues es justamente por eso de Non-reasoning.

Tal vez leíste mi post de la semana pasada donde hablo sobre modelos de razonamiento y ya sabes que hay dos tipos de modelos: los de instrucciones, que simplemente te responden inmediatamente, y los de razonamiento, que se toman su tiempo para responder.

Si no has leído mi post, te cuento que hay dos tipos de LLMs: los de instrucciones, que te responden de inmediato y los de razonamiento, que “piensan” antes de responder.

(No pude evitar repetir esto, al final es un post sobre repetición de prompts ¿no? 😅)

Bueno, resulta que esta técnica funciona sólo con modelos de instrucciones. Y la realidad es que lo más probable es que el asistente que usas todos los días trabaje con un modelo de razonamiento (así que por gusto le andas repitiendo el prompt).

Déjame repetirlo (no pun intended): es casi seguro que tu asistente favorito use un modelo de razonamiento, así que está de más andarle repitiendo el prompt dos veces.

A menos que estés hablando con el modelo de instrucciones, para lo cual tendrías que elegirlo específicamente, y quién querría eso cuando tiene un modelo más potente al lado. Aunque un caso relativamente común es cuando nos conectamos al modelo via API, pero eso es cosa de programadores. Así que dile a tus amigos programadores que todo bien con esta técnica siempre y cuando se conecten al modelo de instrucciones.

¡Aguanta un toque! El hecho que una técnica no nos sirva, no quiere decir que no tenga sentido entender cómo y por qué funciona. Después de todo este blog substack se llama aprendiendoIA y no MiraQuéBonitosPrompts…

Repitiendo los prompts (el paper de Google)

Me imagino que los investigadores, luego de meses de deliberaciones, estudios a profundidad y sobre todo, pensando en el futuro de esta tecnología, se plantearon esta pregunta fundamental:

¿Qué pasa si agarro mi prompt y lo pego dos veces?

Lo que sucedió después es el alboroto de social media que estamos viviendo. Pero antes de llegar a esto, déjame explicarte el paper.

La técnica

Como en cualquier experimento complejo, el equipo de Google Research, necesitaba probar diferentes variantes de su idea. Así que propusieron cuatro técnicas de repetición de prompts:

Repetición simple

La que te imaginas, nada más repites el prompt. Así en vez de preguntar, por ejemplo:

¿Quién es el autor más chévere de substack?

Preguntarías:

¿Quién es el autor más chévere de substack?

¿Quién es el autor más chévere de substack?

Sólo eso, nada más.

Repetición con aviso

Aquí lo que hacen es avisarle al modelo de manera explícita, que van a repetir el prompt. Algo como:

¿Quién es el autor más guapo de substack?

Permíteme repetir eso

¿Quién es el autor más guapo de substack?

En efecto, le estamos avisando que vamos a repetir el prompt antes de repetir el prompt. ¯\_(ツ)_/¯

Repetición triple

En esta técnica, cuidadosamente desarrollada, los investigadores repiten tres veces el mismo prompt, además de avisarle al modelo dos veces que van repetirlo. Yo le hubiera puesto a esta técnica “disco rayado” en vez de repetición triple, pero tal vez suena demasiado analógico para esta época. En fin, se vería algo así:

¿Quién es el autor más buena onda de substack?

Permíteme repetir eso

¿Quién es el autor más buena onda de substack?

Permíteme repetir eso

¿Quién es el autor más buena onda de substack?

Relleno con puntos

Como lo lees, el relleno con puntos se trata de, en lugar de repetir el prompt, escribir la misma cantidad de puntos que los caracteres del prompt. La idea de hacer esto es poder darse cuenta si la mejora en la respuesta se debe a repetir el prompt o simplemente a tener un prompt más largo. Esta técnica se vería algo así:

¿Quién es el autor con mejores metáforas de comida en substack?

...............................................................

Las pruebas

Para probar si efectivamente repetir el prompt mejoraba las respuestas, nuestros aventureros investigadores tomaron diferentes modelos de instrucciones (no de razonamiento) de las principales compañías de IA, como Google, OpenAI, Anthropic y DeepSeek.

Ten en cuenta que si bien el paper se publicó en Diciembre del 2025, las pruebas se hicieron con modelos disponibles entre Febrero y Marzo de ese año (hace un año) y ya sabemos que un año de humano son siete años de perro y 175 años de IA 😅

Los investigadores usaron pruebas estándar de IA (benchmarks, les dicen) y notaron una mejora en los puntajes de esas pruebas al repetir los prompts. Si quieres saber un poco más de estos benchmarks, hace casi dos años escribí al respecto, dale una mirada. Creo que es un tema muy bacán, y prometo actualizar el post para incluir los más modernos.

Pero esas no fueron todas las pruebas que hicieron, de hecho inventaron dos pruebas nuevas para probar a estos modelos: NameIndex y MiddleMatch.

NameIndex

Esta prueba se trata de darle a la IA una lista de cincuenta nombres y preguntarle cuál está en una posición específica.

Aquí el prompt para que te des una idea:

Here’s a list of names:

Dale Lopez, Peter Sanchez, Allen Harris, Scott Davis, Hudson Leviathan,

Daphne Kalman, Dennis Davis, Henry King, Alfred Cooper, Bruce Usher, Travis

Ramirez, Rafael Jennings, Richard Rogers, Walter Young, Caleb Harris, Ben

Kalman, Donald Carter, Richard Sterling, Mark Nightingale, Steven Carter,

Talia Kalman, Dennis Hanson, James Harris, Craig Chavez, Paul Sanchez,

Samuel Curtis, Jacob James, Allen Thomas, Dale Evans, James Fox, Douglas

Allen, Orion Johnson, Alexander Wright, Eugene Morrison, Nelson Lee, Alan

Young, Caleb Ward, Alberto Robinson, Robert McCarthy, Mark Price, Kenneth

Ramirez, Jeffrey White, Chad Cooper, Arthur Waters, Bruce Callahan, Liam

Leviathan, Steven Robinson, Alberto Murphy, Leonard Johnson, Robert Murphy

What’s the 25th name?Se me ocurrió probarlo sin usar repetición, es decir poniendo el prompt sólo una vez, en los modelos más básicos de Anthropic (Haiku 4.5) y OpenAI (ChatGPT 5.3 Instant) y ambos respondieron de manera correcta.

Nota: En mi día a día jamás uso Haiku 4.5 ni ChatGPT Instant (me imagino que tú tampoco).

MiddleMatch

Esta es una prueba más complicada, le damos una lista de cuarenta nombres, donde algunos de los nombres se repiten, y le pedimos al modelo que nos dé el nombre que se encuentra exactamente entre dos nombres específicos.

Aquí el prompt que usaron.

Here’s a list (potentially with repetitions) of names:

Carlos Davis, Dale Sims, Carlos Davis, Dale Sims, Stephen Cruz, Dale Sims,

Finnian Ross, Stephen Cruz, Stephen Cruz, Gregory Collins, Dale Sims,

Stephen Cruz, Carlos Davis, Stephen Cruz, Dale Sims, Dale Sims, Stephen

Cruz, Stephen Cruz, Leonard Kalman, Bruce Phillips, Raymond Roberts, Dale

White, Leonard Kalman, Finnian Ross, James Wright, Finnian Ross, Raymond

Roberts, Dale Sims, Dale Sims, Leonard Kalman, Dale Sims, Carlos Davis,

Leonard Kalman, Bruce Phillips, Dale Sims, Raymond Roberts, Gregory Collins,

Gregory Collins, Dale Sims, Finnian Ross

What is the single name that appears right between Carlos Davis and Bruce

Phillips?Cuando lo probé con Claude (Haiku 4.5) respondió de forma correcta inmediatamente, buena Claude! Pero cuando le di ese prompt a ChatGPT Instant, me respondió cualquier cosa.

Entonces decidí darle el prompt dos veces a ChatGPT Instant, a ver si con eso mejoraba la respuesta… y me dio la respuesta correcta!

Eso significa que esta técnica de prompting funciona… si usas un modelo como ChatGPT Instant, porque parece que del lado de Claude, su modelo Haiku ha mejorado bastante en el último año y ya no necesitaría estas artimañas.

BTW, Claude es mi asistente favorito, sus modelos son increíbles y tiene un conjunto de funcionalidades que lo convierten en el mejor asistente de IA a la fecha. Si aún no lo has probado, escribí una guía con absolutamente todo lo que necesitas saber sobre Claude.

Nota: Estas pruebas las hice con los asistentes, así que no descarto que hayan podido usar herramientas. De todas formas, si eres un developer usando el API vale la pena repetirlas.

¿Por qué funciona?

Los LLMs leen tu prompt palabra por palabra (en realidad es token por token, pero no quiero ponerme técnico) y relacionan cada palabra sólo con las que leyeron antes. Digamos que como leen de izquierda a derecha, no saben qué palabra viene después y eso hace que “olviden” algunas cosas que ya leyeron.

Imagina que decidiste visitar Lima y nos fuimos a tomar un café (y a hablar de comida, por supuesto), así que te estoy dando instrucciones para llegar a la mejor cevichería de Lima:

“Sales de tu hotel, caminas cinco cuadras por el malecón hasta que llegues al puente que separa Miraflores de Barranco, lo cruzas y avanzas por la avenida hasta llegar al café que tiene la pared amarilla. Ahí doblas a la derecha y sigues de frente hasta que llegues a un restaurant azul, esa es la cevichería.

No te puedes perder.

También puedes tomar taxi”

Ahora imagina que estás en la puerta de tu hotel y yo te acabo de dar esas instrucciones. Si eres como yo probablemente para cuando mencioné “restaurant azul” ya te habías olvidado para qué lado del malecón tenías que ir o si la pared del café que mencioné era amarilla, naranja o multicolor.

Pero, si te doy las instrucciones completas dos veces, la segunda vez que escuchas que tienes que caminar por el malecón ya tienes la mirada completa de tu ruta, sabes que hay un puente, ya escuchaste que la cevichería tiene una pared azul y todo tiene más sentido para tu cerebro.

Creo que es algo que a mí me serviría… ¿será que mi cerebro funciona como un modelo de instrucciones y no de razonamiento? 😱 (y que mi mamá lo sabía cuando me repetía las cosas más de una vez).

Para no salirnos del tema, te cuento que a los LLMs les pasa eso mismo. Procesan tu prompt token por token y no saben qué es lo que viene después. Ahora, cuando repetimos el prompt, cuando al LLM le toca procesar el segundo prompt ya tiene el primero para saber qué es lo que tiene que esperar. Y eso es lo que mejora sus respuestas. Tiene sentido, ¿no?

Por eso, cuando vemos las pruebas de NameIndex y MiddleMatch, tiene sentido que responda mejor porque necesita haber visto la pregunta antes que toda la lista para entenderla y responder mejor, y eso es justamente lo que sucede si repetimos el prompt.

Los resultados

Ya sabes cómo hicieron este experimento, estas pruebas las realizaron con las cuatro variantes de la repetición del prompt: repetición simple, repetición con aviso, repetición triple (o el disco rayado) y relleno con puntos.

Hicieron 70 combinaciones de estas pruebas con los diferentes modelos y de esas setenta, tuvo mejores respuestas en 47 y en ningún caso empeoró la respuesta, así que podemos decir que es una técnica que “no hace daño”.

Todos los tipos de repetición tuvieron buenos resultados, excepto el relleno con puntos. Eso tiene sentido porque realmente no estamos repitiendo el prompt, sino usándolo como un experimento de control.

En los casos de NameIndex y MiddleMatch la repetición triple fue claramente superior al resto de técnicas. Ya lo decía mi mamá, hay que repetir las cosas varias veces para que se entiendan… parece que eso también aplica a la IA (al menos para modelos de instrucciones).

Si crees que repetir el prompt puede hacer que tome más tiempo la respuesta, pues no es un problema. Durante las pruebas los modelos no se demoraron más en responder ni lo hicieron más rápido. Bueno, todos menos Claude, que se tomaba más tiempo cuando los prompts eran muy largos o con triple repetición.

Tampoco generaron tokens extra, como pasa en el razonamiento, así que no son más caros (excepto por los extra tokens de repetir el prompt).

¿Y en modelos de razonamiento?

La gente de Google Research no usó modelos de razonamiento, pero sí probó una técnica de prompting llamada Chain of Thought (CoT), que es básicamente pedirle al modelo que piense antes de responder.

Estos no son modelos de razonamiento sino modelos de instrucciones que están “pensando en voz alta la respuesta”, pero con esta técnica, los modelos tratan de “razonar”. Y bueno, resulta que no hay una mejora cuando repetimos el prompt usando Chain of Thought.

Si lo pensamos bien, tiene sentido. Cuando un modelo razona, de alguna manera está “repasando” la pregunta, es decir que ya está haciendo lo que propone el paper.

¿Y ahora qué hacemos?

Bueno…

Si estás usando un asistente como Claude, ChatGPT o Gemini, no creo que tenga sentido que estés repitiendo tu prompt.

Permíteme repetir eso.

Si estás usando un asistente como Claude, ChatGPT o Gemini, no creo que tenga sentido que estés repitiendo tu prompt.

(Lo siento, no pude evitar hacer la repetición con aviso… creo que también la voy a probar con mis hijos a ver si consigo que me hagan caso a la primera).

Si eres un developer o eres parte de un equipo que está conectándose a un LLM de instrucciones, vale la pena, al menos, probar los resultados que te da.

En fin, la próxima vez que veas una técnica milagrosa de prompting en LinkedIn redes sociales, mira si es algo que realmente aplica a tu día a día, y no sólo la uses, sino trata de entender por qué debería funcionar.

Abrazo,

G

Súper interesante todo esto. Lo que más me hizo pensar es eso de que casi nadie usa modelos sin razonamiento, al menos no para tareas con cierta carga. Hace dos días los LRM eran una novedad. Ahora son la norma.

La chancla! Me encanta como las imágenes han evolucionado hasta volverse su propia historia secundaria